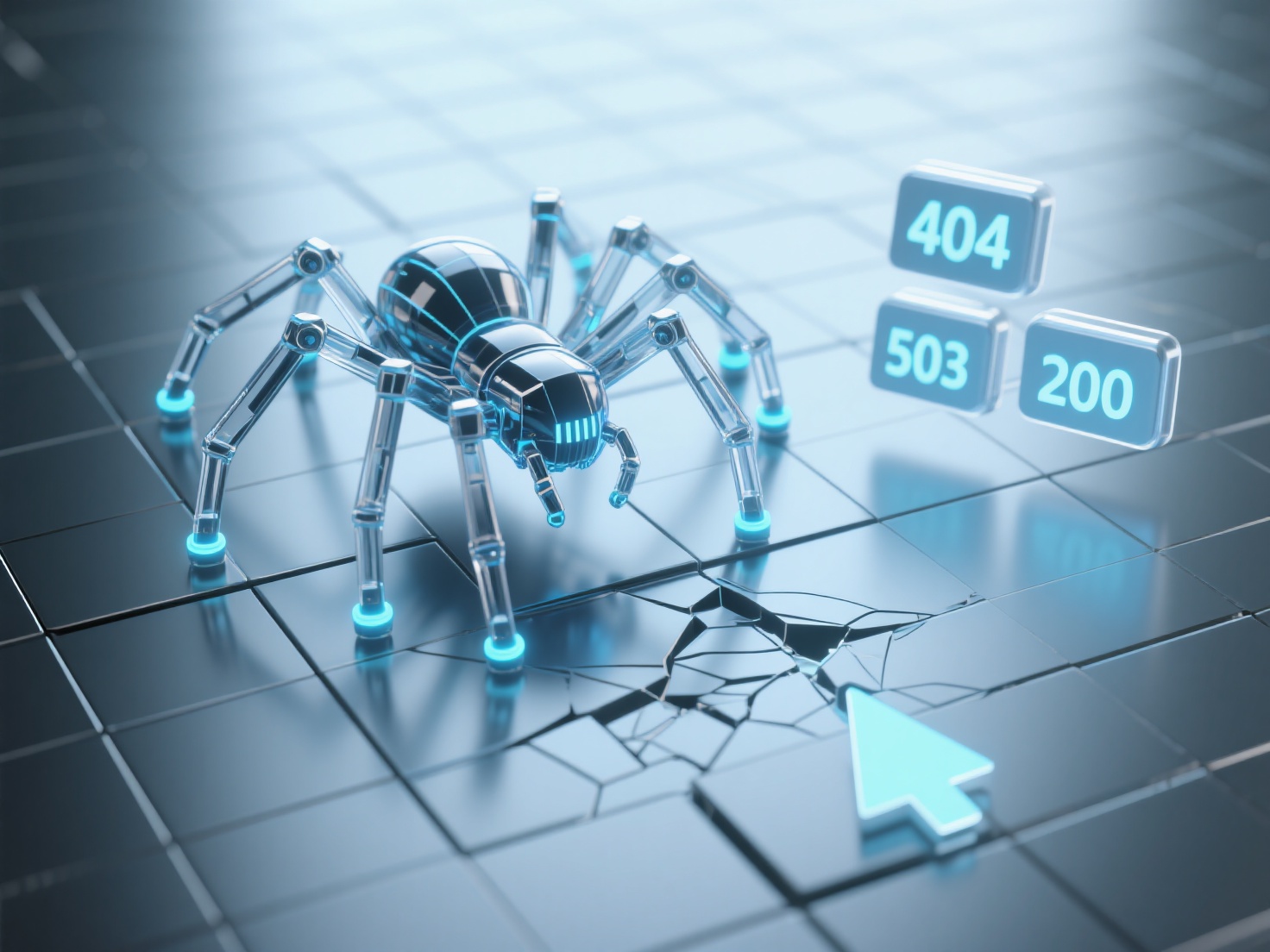

robots.txt 与 Noindex 标签同时使用时哪个优先?

当 robots.txt 与 Noindex 标签同时作用于同一页面时,通常 Noindex 标签不会生效。因为 robots.txt 的核心功能是限制搜索引擎爬虫抓取页面,若页面被 robots.txt 禁止抓取,爬虫无法访问该页面,自然无法读取 Noindex 标签,导致 Noindex 指令失效。 具体存在两种典型场景: - 场景1:robots.txt 禁止抓取 + Noindex 标签:爬虫因 robots.txt 限制无法访问页面,Noindex 标签不被读取,页面可能仍被索引(若之前已抓取)或无法被正确处理。 - 场景2:robots.txt 允许抓取 + Noindex 标签:爬虫可正常访问页面并读取 Noindex 标签,此时 Noindex 生效,页面不会被索引。 实际操作中,若需阻止页面被索引,建议仅使用 Noindex 标签(确保页面可抓取);若需完全阻止爬虫访问,可使用 robots.txt。避免同时使用导致 Noindex 失效,影响页面在搜索引擎中的可见性管理。